Google a déclaré que sa dernière mise à jour majeure en matière de recherche, l'inclusion de l' algorithme BERT , l'aiderait à mieux comprendre l'intention des requêtes de recherche des utilisateurs, ce qui devrait se traduire par des résultats plus pertinents. BERT aura un impact sur 10% des recherches, a indiqué la société, ce qui signifie qu'il est susceptible d'avoir un impact sur la visibilité organique et le trafic de votre marque. Vous pourriez ne pas vous en rendre compte .C’est notre regard de haut niveau sur ce que nous savons jusqu’à présent sur ce que Google revendique comme «l’un des plus grands progrès de l’histoire de la recherche». Lorsque vous êtes prêt à aller plus loin, découvrez notre article complémentaire: A deep Plongez dans BERT : Comment BERT a lancé une fusée dans la compréhension du langage naturel, par Dawn Anderson.

Lire aussi: BERT de Google: Comment BERT a lancé une fusée dans la compréhension du langage naturel

Quand BERT a-t-il été lancé dans la recherche Google?

BERT a commencé à être intégré dans le système de recherche de Google la semaine du 21 octobre 2019 pour les requêtes en langue anglaise, y compris les extraits en vedette (Featured Snippets) .

L'algorithme s'étendra à toutes les langues dans lesquelles Google propose la recherche, mais il n'y a pas encore de calendrier défini, a déclaré Danny Sullivan , de Google. Un modèle BERT est également utilisé pour améliorer les extraits sélectionnés dans deux douzaines de pays.

Qu'est ce que le BERT?

BERT, ou Bidirectional Encoder Representations de Transformers, est une technique basée sur un réseau de neurones pour la pré-formation au traitement du langage naturel. En clair, il peut être utilisé pour aider Google à mieux discerner le contexte des mots dans les requêtes de recherche.

Par exemple, dans les expressions «neuf à cinq» et «un quart à cinq», le mot «to» a deux significations différentes, ce qui peut être évident pour les humains mais moins pour les moteurs de recherche. BERT est conçu pour faire la distinction entre ces nuances afin d'obtenir des résultats plus pertinents.

BERT Google open source en novembre 2018. Cela signifie que n'importe qui peut utiliser BERT pour former son propre système de traitement de la langue à la réponse à une question ou à d'autres tâches.

Qu'est-ce qu'un réseau de neurones?

Les réseaux neuronaux d'algorithmes sont conçus pour la reconnaissance de formes, pour le dire très simplement. Classer le contenu des images, reconnaître l'écriture manuscrite et même prévoir les tendances des marchés financiers sont des applications courantes du monde réel pour les réseaux de neurones - sans parler des applications de recherche telles que les modèles de clic .

Ils s'entraînent sur des ensembles de données pour reconnaître les modèles. BERT a été pré-formé à l’aide du corpus en clair de Wikipedia, a expliqué Google lorsqu’il l’a ouvert.

Qu'est-ce que le traitement du langage naturel?

Le traitement du langage naturel (PNL) fait référence à une branche de l'intelligence artificielle qui traite de la linguistique, dans le but de permettre aux ordinateurs de comprendre la façon dont les humains communiquent naturellement.

Les exemples d'avancées rendues possibles par la PNL comprennent les outils d'écoute sociale , les chatbots et les suggestions de mots sur votre smartphone.

En soi, la PNL n'est pas une nouvelle fonctionnalité pour les moteurs de recherche. Le BERT, cependant, représente une avancée en PNL grâce à une formation bidirectionnelle (plus de détails ci-dessous).

Comment fonctionne le BERT de Google?

L’innovation décisive de BERT réside dans sa capacité à former des modèles linguistiques basés sur l’ensemble des mots d’une phrase ou d’une requête (formation bidirectionnelle) plutôt que sur la méthode traditionnelle d’entraînement sur la séquence de mots ordonnée (gauche à droite ou combinée à gauche). -à droite et de droite à gauche). BERT permet au modèle de langage d'apprendre le contexte de mot basé sur les mots qui l'entourent plutôt que simplement le mot qui le précède ou le suit immédiatement.

Google appelle BERT «profondément bidirectionnel» car les représentations contextuelles des mots commencent «tout au fond d'un réseau de neurones profonds».

«Par exemple, le mot« banque »aurait la même représentation sans contexte dans les termes« compte bancaire »et« banque de la rivière ». Les modèles contextuels génèrent plutôt une représentation de chaque mot basée sur les autres mots de la phrase. Par exemple, dans la phrase " J'ai accédé au compte bancaire ", un modèle contextuel unidirectionnel représenterait une " banque " basée sur " J'ai accédé au " mais pas " compte ." Cependant, BERT représente " banque " en utilisant à la fois son contexte précédent et suivant - " j'ai accédé au compte … ". "

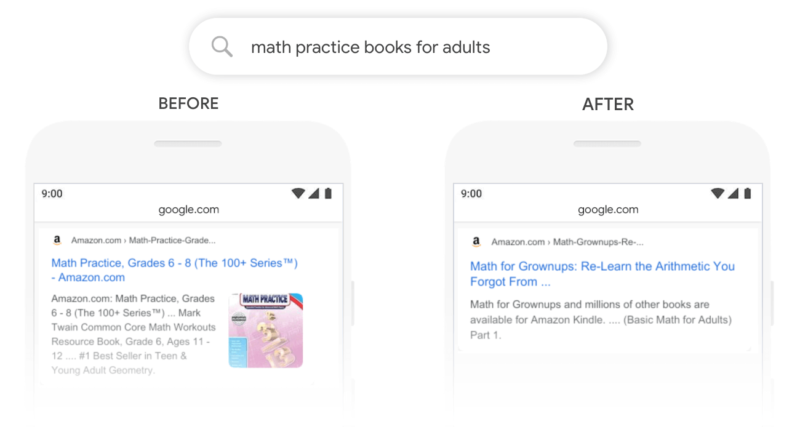

Google a montré plusieurs exemples d'impact de l'application de BERT dans les resulats de recherche SERPs les résultats. Dans un exemple, la requête «livres de pratique de maths pour adultes» avait précédemment fait apparaître une liste de livres pour la 6e à la 8e année en haut des résultats organiques. Lorsque BERT est appliqué, Google affiche en tête des résultats un ouvrage intitulé «Maths for Grownups».

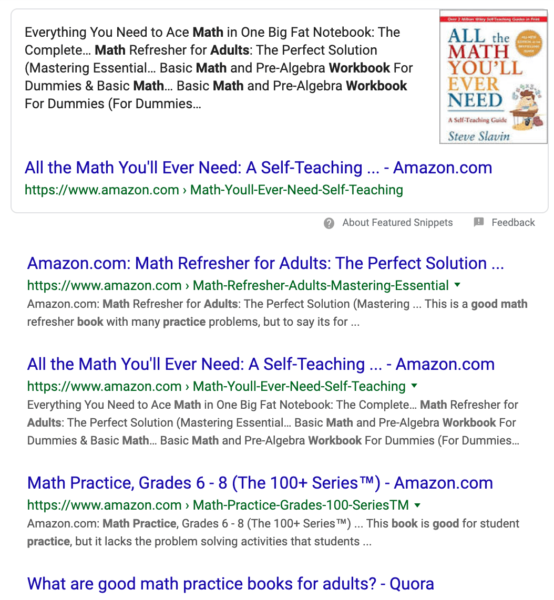

Dans le résultat actuel de cette requête, vous pouvez voir que le livre de la 6e à la 8e année est toujours en cours de classement, mais il existe deux livres spécifiquement destinés aux adultes se classant au-dessus, y compris dans l'extrait sélectionné.

Un changement dans les résultats de la recherche, comme celui ci-dessus, reflète la nouvelle compréhension de la requête utilisant BERT. Le contenu Jeune adulte n'est pas pénalisé, mais les listes spécifiques aux adultes sont réputées mieux alignées sur l'intention du chercheur.

Google utilise-t-il le BERT pour donner un sens à toutes les recherches?

Non, pas exactement. BERT améliorera la compréhension de Google concernant environ une recherche sur 10 en anglais aux États-Unis.

"En particulier pour les requêtes plus longues et plus conversationnelles, ou les recherches où les prépositions comme" pour "et" pour "importent beaucoup pour le sens, la recherche sera en mesure de comprendre le contexte des mots de votre requête", a écrit Google dans son blog. .

Cependant, toutes les requêtes ne sont pas conversationnelles ou n'incluent pas de prépositions. Les recherches par marque et les expressions plus courtes ne sont que deux exemples de types de requêtes qui peuvent ne pas nécessiter le traitement du langage naturel par BERT.

Quel impact BERT aura-t-il sur mes extraits sélectionnés?

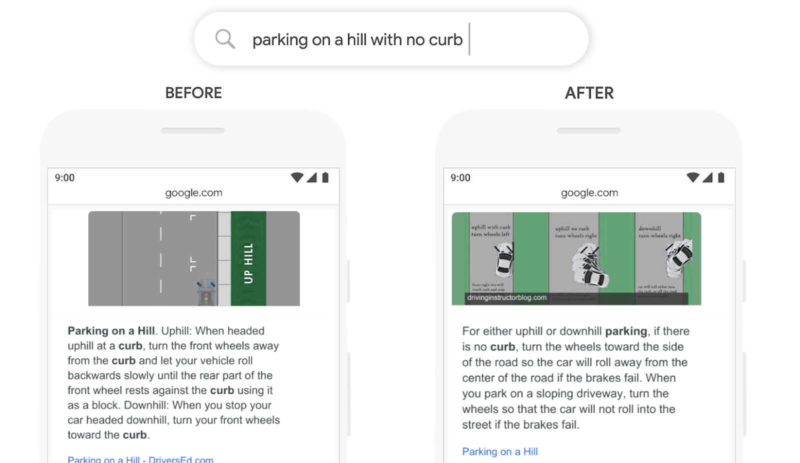

Comme nous l'avons vu dans l'exemple ci-dessus, BERT peut affecter les résultats qui apparaissent dans les extraits sélectionnés lors de son application.

Dans un autre exemple ci-dessous, Google compare les extraits présentés pour la requête "Stationner sur une colline sans bordure", expliquant: "Dans le passé, une requête de ce type confondait nos systèmes. Nous avons accordé trop d'importance au mot" bordure ". et ignoré le mot «non», ne comprenant pas à quel point ce mot était essentiel pour répondre de manière appropriée à cette requête. Donc, nous retournerions les résultats pour un parking sur une colline avec un trottoir. "

https://searchengineland.com/figz/wp-

https://searchengineland.com/figz/wp-Quelle est la différence entre BERT et RankBrain?

Certaines des fonctionnalités de BERT peuvent sembler similaires à la première méthode d'intelligence artificielle utilisée par Google pour comprendre les requêtes, RankBrain . Mais, ce sont deux algorithmes distincts qui peuvent être utilisés pour informer les résultats de recherche.

«La première chose à comprendre à propos de RankBrain est qu’il fonctionne en parallèle avec les algorithmes de classement de recherche organiques normaux et qu’il permet d’ajuster les résultats calculés par ces algorithmes», a déclaré Eric Enge, directeur général de Perficient Digital.

RankBrain ajuste les résultats en examinant la requête en cours et en recherchant des requêtes antérieures similaires. Ensuite, il examine les performances des résultats de la recherche pour ces requêtes historiques. «En fonction de ce qu'il voit, RankBrain peut ajuster la sortie des résultats des algorithmes de classement de recherche organiques normaux», a déclaré Enge.

RankBrain aide également Google à interpréter les requêtes de recherche afin qu'il puisse afficher des résultats qui ne contiennent peut-être pas les mots exacts. Dans l'exemple ci-dessous, Google a pu comprendre que l'utilisateur cherchait des informations sur la Tour Eiffel, alors que le nom de la tour n'apparaissait pas dans la requête "hauteur du point de repère à paris".

https://searchengineland.com/figz/wp-

https://searchengineland.com/figz/wp-"BERT fonctionne d'une manière complètement différente", a déclaré Enge. «Les algorithmes traditionnels essaient d’examiner le contenu d’une page pour comprendre de quoi il s’agit et ce à quoi il pourrait être pertinent. Cependant, les algorithmes PNL traditionnels ne peuvent généralement que regarder le contenu avant un mot OU le contenu après un mot pour un contexte supplémentaire afin de l'aider à mieux comprendre le sens de ce mot. Le composant bidirectionnel de BERT est ce qui le rend différent ». Comme mentionné ci-dessus, BERT examine le contenu avant et après un mot pour éclairer sa compréhension de la signification et de la pertinence de ce mot. "Il s'agit d'une amélioration cruciale du traitement du langage naturel car la communication humaine est naturellement complexe et de plusieurs couches."

BERT et RankBrain sont utilisés par Google pour traiter les requêtes et le contenu des pages Web afin de mieux comprendre la signification des mots.

BERT n'est pas là pour remplacer RankBrain. Google peut utiliser plusieurs méthodes pour comprendre une requête, ce qui signifie que BERT peut être appliqué seul, avec d'autres algorithmes de Google , en tandem avec RankBrain, quelle que soit leur combinaison ou pas du tout, en fonction du terme recherché.

Quels autres produits Google le BERT pourrait-il affecter?

L'annonce de BERT par Google concerne uniquement la recherche, mais cela aura également un impact sur l'assistant. Lorsque des requêtes effectuées dans Google Assistant déclenchent la fourniture d'extraits de contenu ou de résultats Web de la recherche, ces résultats peuvent être influencés par BERT.

Google a déclaré à Search Engine Land que le moteur BERT n’était pas utilisé pour les annonces mais qu’il serait éventuellement intégré, cela pourrait contribuer à atténuer certaines des mauvaises variantes proches qui correspondent aux fléaux annonceurs.

«Comment puis-je optimiser pour BERT?» Ce n'est pas vraiment une façon de penser

"Il n'y a rien d'optimiser pour BERT, ni rien qui puisse être repensé", a déclaré Sullivan. "Les fondamentaux de nous qui cherchent à récompenser un excellent contenu restent inchangés."

Le conseil de Google en matière de classement a toujours été de garder l’utilisateur en tête et de créer un contenu qui corresponde à son objectif de recherche. Étant donné que BERT est conçu pour interpréter cette intention, il est logique de donner à l'utilisateur ce qu'il souhaite continuer à être le conseil de choix de Google.

L’optimisation signifie désormais que vous pouvez vous concentrer davantage sur une bonne écriture, au lieu de faire un compromis entre la création de contenu pour votre public et la construction de phrasé linéaire pour les machines.

Voir aussi: Qu'est-ce que Google MUM et comment cela affectera votre SEO ?